Column

コラム

AIデータ分析コラム【29】AIガバナンス

2025.07.01

近年、ChatGPTに代表される生成AI(Generative AI)の普及により、簡単に文章や画像を生成できるようになり、生活や業務でのAIの利用が進んでいます。

一方で、誰でも簡単に様々なものを作れるようになったことで、フェイクニュースの拡散、著作権の問題、犯罪への悪用など、 AIに伴う課題も顕在化しています。 例えば、偽のニュース記事がSNSで拡散されることで社会的混乱を引き起こす、生成された画像が著作権を侵害するケースなどが報告されています。これらの問題は、AIシステムを開発・提供する事業者だけでなく、利用する事業者・個人にとっても重大な課題です。

AI規制に関する動き

これらのAIの問題に関連し、 AI規制に関する議論は欧州連合(EU)で2020年から先行して開始され、 2024年5月21日に、欧州市場でAIシステムを開発・提供・利用する事業者を対象とする法的拘束力を持つ世界初の包括的なAI規制法であるAI法(AI Act)が成立しました。[1]

日本においても、AIの倫理的・社会的課題に関する議論は2015年頃から活発化しており、2023年4月に日本で開催されたG7のデジタル・技術大臣会合にて、生成AIの急速な普及と進展を背景に「責任あるAIとAIガバナンスの推進」などが議論されました。2023年5月には日本政府が「AI戦略会議」を設置し、AIのリスクへの対応、AIの最適な利用に向けた取り組み、AIの開発力強化に向けた方策など、様々なテーマの議論を加速させました[2]。その後、2025年2月28日に「人工知能関連技術の研究開発及び活用の推進に関する法律案」(AI推進法)が閣議決定され、同年5月28日に国会で賛成多数で可決・成立しました。AI推進法は、AIの活用を推進し、国民生活の向上や経済の発展を目指すもので、AI関連技術の研究開発や活用推進を計画的に進める計画「人工知能基本計画」の策定、内閣に「人工知能戦略本部」を置き、全ての国務大臣が参加することを定めています。罰則規定はありませんが、企業にはAI活用に伴うリスクへの十分な配慮と自主的な安全対策の実施が求められています。

以下、本稿では、AIガバナンスの概要と企業が取り組むべきAIガバナンス構築について、特にAI利用者の視点を中心に解説します。

AIガバナンスの構築

AIガバナンスとは、総務省・経済産業省が公表した「AI事業者ガイドライン(第1.1版)」[3]によると、「AIの利活用によって生じるリスクをステークホルダーにとって受容可能な水準で管理しつつ、そこからもたらされる正のインパクト(便益)を最大化することを目的とする、ステークホルダーによる技術的、組織的、及び社会的システムの設計並びに運用」と定義されています。

企業は生成AIを活用することで業務の効率化など利益を最大化することができますが、ハルシネーション(事実と異なる情報を生成する現象(虚偽情報の生成など))や情報漏洩リスク、著作権侵害などのリスクを抱えます。このため、企業はAIガバナンスの重要性を認識し、企業の利益を最大化するAI活用方法を検討することが必要です。前述の「AI事業者ガイドライン(第1.1版)」には、AIガバナンスの構築についての検討指針が記されています。

![図1. アジャイル・ガバナンスの基本的なモデル(出典:AI事業者ガイドライン(第1.1版)[3] ※掲載図を同様に再作成)](https://www.ntt-at.co.jp/column/assets/ai_column_no29-Basic_model_of_Agile_Governance.png)

AIシステム・サービスに関連する「環境・リスク分析」を実施し、AIガバナンスに関するポリシーの策定等を通じて「AIガバナンス・ゴールの設定」を検討します。このAIガバナンス・ゴールを達成するための「AIマネジメントシステムのデザイン」を行い、「マネジメントシステムを運用」、マネジメントシステムが有効に機能しているかを継続的にモニタリングし、「評価」及び継続的改善を行うことを提示しています。本ガイドラインでも、「事前にルール⼜は⼿続が固定された AIガバナンスではなく、企業・法規制・インフラ・市場・社会規範といった様々なガバナンスシステムにおいて、「環境・リスク分析」「ゴール設定」「システムデザイン」「運⽤」「評価」といったサイクルを、マルチステークホルダーで継続的かつ⾼速に回転させていく、「アジャイル・ガバナンス」の実践が重要となる」と述べています。

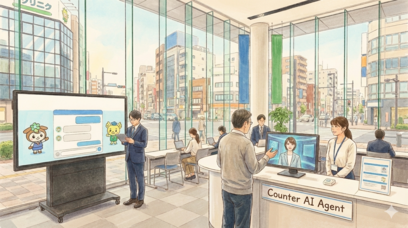

本ガイドラインでは、AI の事業活動を担う主体を、「AI 開発者」、「AI 提供者」及び「AI 利⽤者」の3つに⼤別し整理しています。そのうち、「AI利用者」においての留意事項をいくつか紹介すると、AI システム・サービス利⽤時の「U-2)i. 安全を考慮した適正利⽤」として「AI の出⼒について精度及びリスクの程度を理解し、様々なリスク要因を確認した上で利⽤する」、「U-3)i. ⼊⼒データ⼜はプロンプトに含まれるバイアスへの配慮」として「著しく公平性を⽋くことがないよう公平性が担保されたデータの⼊⼒を⾏い、プロンプトに含まれ るバイアスに留意して、責任をもって AI 出⼒結果の事業利⽤判断を⾏う」、「U-4)i. 個⼈情報の不適切⼊⼒及びプライバシー侵害への対策」として「AI システム・サービスへ個⼈情報を不適切に⼊⼒することがないよう注意を払う」など重要な事項を記載しています。 「AI事業者ガイドライン(第1.1版)」別添[4]には AI システム・サービスの例及び具体的な活用例、主体のパターン例など記載されており、より具体的な取り組みを理解できます。詳細はガイドラインを参照ください。

生成AIを利用したサービスは様々な分野で次々と提供されており、多くの方が業務で便利に利用しているのではないかと思います。一方でAIガバナンスの観点で様々なリスクが潜んでいることにも注意が必要です。現在では、生成AIの導入を支援する各種サービスが提供されており、例えば、入力データに個人情報が含まれていないかを自動的に検出・チェックするツールなども登場しています。こうした市販のサービスやツールを積極的に活用することで、安全かつ効果的な生成AIの利用を促進できるでしょう。

まとめ

本ガイドラインは、企業のAI利用状況に応じてリスクベースアプローチを採用し、重点的に対策すべき事項を見極め効果的なAIガバナンス構築を期待しています。今後、企業はAIによるイノベーションを促進しつつ、リスクを適切に管理することが不可欠となるでしょう。

参考文献

[1] 令和6年版 情報通信白書,https://www.soumu.go.jp/johotsusintokei/whitepaper/ja/r06/html/nd142210.html (2025年6月20日閲覧).

[2] 令和6年版 情報通信白書,https://www.soumu.go.jp/johotsusintokei/whitepaper/ja/r06/pdf/n1420000.pdf (2025年6月20日閲覧).

[3] 「AI事業者ガイドライン(第1.1版)」本編, https://www.soumu.go.jp/main_content/001002576.pdf (2025年6月20日閲覧).

[4] 「AI事業者ガイドライン(第1.1版)」別添 https://www.soumu.go.jp/main_content/001000988.pdf (2025年6月20日閲覧).

お問い合わせ

AIデータ分析コラム

このコラムは、NTT-ATのデータサイエンティストが、独自の視点で、AIデータ分析の技術、市場、時事解説等を記事にしたものです。

本コラムの著作権は執筆担当者名の表示の有無にかかわらず当社に帰属しております。